L’IA ne deviendra pas humaine en se trompant ; elle deviendra utile en vous aidant à ne plus vous tromper seul. Dans le monde de la paie et des ressources humaines, l’erreur n’est pas une option. Un bulletin de paie faux, c’est un salarié démotivé. Une mauvaise interprétation d’une convention collective, c’est un risque juridique immédiat.

Alors, quand on entend que les IA les plus avancées “hallucinent” ou commettent des erreurs statistiques, le réflexe naturel est la fermeture : “Pas chez nous. Trop risqué.” Pourtant, refuser l’assistance de l’IA sous prétexte qu’elle n’est pas infaillible est un paradoxe étonnant. Chez Okawai, nous pensons qu’il est temps de changer de perspective : le sujet n’est pas la perfection de l’outil, mais la maîtrise de la collaboration entre l’humain et la machine.

L’assistant n’est pas le remplaçant On se met en situation: un collaborateur ultra-rapide capable de lire 500 pages de jurisprudence en trois secondes. Il vous présente un résumé, pointe les articles de loi pertinents et suggère une réponse à un salarié. Allez-vous signer son document les yeux fermés ? Bien sûr que non.

L’IA doit être vue comme un copilote de recherche et non comme un décideur :

- Synthèse de la donnée : Elle agrège vos accords d’entreprise et le Code du Travail.

- Vulgarisation : Elle traduit un jargon complexe en explications simples pour vos managers.

- Aide à la décision : Elle propose, vous disposez.

Le dernier clic — celui qui engage la responsabilité de l’entreprise — reste et doit rester humain. C’est le principe de “Human Agency” (le contrôle humain) que nous défendons fermement.

Le paradoxe de l’erreur humaine Nous acceptons que “l’erreur est humaine”. Un gestionnaire de paie fatigué peut rater une ligne de calcul. Un juriste peut passer à côté d’une mise à jour réglementaire. Selon certaines études, près d’un tiers des entreprises subissent des retards de paie liés à des bugs ou des erreurs de saisie.

Pourtant, nous sommes intraitables avec l’IA. Pourquoi ? Parce que nous attendons d’elle une nature divine alors qu’elle est purement statistique. Ironiquement, refuser l’IA parce qu’elle peut se tromper, c’est se priver d’un outil qui, bien utilisé, réduit drastiquement le taux d’erreur global de l’humain.

La transparence comme remède à l’incertitude

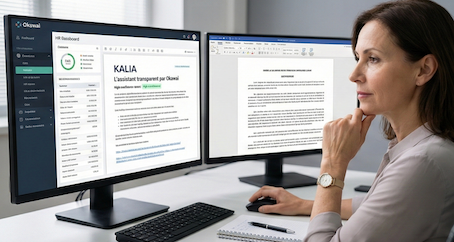

Le vrai danger n’est pas l’erreur de l’IA, c’est l’IA “boîte noire“. Pour qu’un assistant soit viable dans un service RH, il doit être explicable. Si votre logiciel de gestion des talents suggère qu’un profil n’est pas adapté, il doit vous dire pourquoi. Sur quelles sources s’appuie-t-il ? Quelles données a-t-il croisées ?

Chez Okawai, nous intégrons cette transparence dès la conception. Notre assistant, Kalia :

- Citer ses sources (liens directs vers le document interne ou légal).

- Afficher son niveau de confiance.

- Permettre une validation humaine systématique.

Ce que dit la loi (et votre éthique)

L’utilisation de l’IA en RH n’est plus une zone grise. Le Règlement Européen sur l’IA (AI Act) classe de nombreux systèmes RH (recrutement, évaluation, gestion du personnel) comme “à haut risque”. Cela impose des obligations strictes de transparence, de qualité des données et de contrôle humain.

L’éthique n’est pas une option, c’est le moteur de l’adoption. Si vos équipes ne font pas confiance à l’outil car ils craignent des biais discriminatoires ou des fuites de données confidentielles, votre projet échouera. C’est là que l’expérience de 25 ans des fondateurs d’Okawai intervient : transformer cette contrainte légale en un socle de confiance pour vos salariés.

L’IA ne deviendra pas humaine en se trompant ; elle deviendra utile en vous aidant à ne plus vous tromper seul.

L’IA de confiance ne s’improvise pas, elle se construit. Que vous soyez en phase de réflexion ou en pleine tempête sur un projet qui dérape, échangeons sur votre vision.