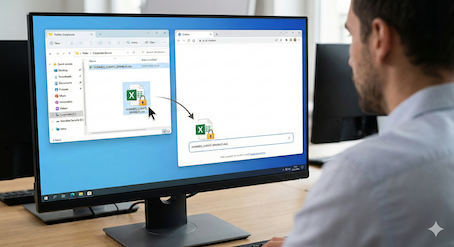

Aujourd’hui, l’intelligence artificielle est partout, mais pas toujours là où les directions informatiques l’attendent. Une tendance majeure émerge : le “Bring Your Own AI” (BYOAI), où les employés utilisent leurs propres outils d’IA sans contrôle officiel. Les sources révèlent que si 88 % des employés utilisent l’IA au travail, une grande partie de cet usage se fait dans l’ombre. C’est, après la lecture de l’excellent article d’EY “Work Reimagined 2025”, que j’ai vu mettre ce phénomènes en lumière et vous proposer quelques pistes de réflexions.

L’usage de l’IA est devenu quasi universel, mais il est souvent superficiel ou non encadré. Entre 23 % et 58 % des collaborateurs (selon les secteurs) apportent leurs propres outils d’IA au bureau, allant parfois jusqu’à payer leurs propres abonnements personnels pour gagner en efficacité. Le moteur principal n’est pas la rébellion, mais la pression de performance.

- Surcharge de travail : 64 % des employés ont perçu une augmentation de leur charge de travail au cours des 12 derniers mois.

- Peur de l’obsolescence : 38 % des salariés craignent de perdre leur emploi s’ils ne sont pas remplacés par l’IA, ce qui les pousse à expérimenter seuls pour rester compétitifs.

- Décalage technologique : Les outils d’entreprise sont souvent perçus comme moins performants ou plus lents à déployer que les solutions grand public.

Les conséquences : Un cocktail de risques en termes de **sécurité, de gouvernance et de conformité

- Non-conformité et RGPD : L’utilisation de modèles publics sans garde-fous expose l’entreprise au partage involontaire de données protégées ou d’informations privilégiées.

- Non-conformité AI Act : En utilisant des outils d’IA non contrôlés, les collaborateurs peuvent introduire des systèmes qui entrent dans la catégorie des IA « à haut risque » selon la réglementation européenne (AI Act). Le non-respect des règles de transparence, de gestion des risques et de gouvernance des données imposées par cette loi expose l’entreprise à des sanctions juridiques et financières majeures (information externe aux sources).

- Outre les fuites de données, le Shadow AI empêche la capitalisation sur l’innovation. Si l’innovation est diffuse et cachée, l’entreprise ne peut pas transformer ses processus à grande échelle.

- Un usage non encadré peut mener à des erreurs de décision dues à des hallucinations de l’IA, ou à des sanctions disciplinaires en cas de **violation des politiques de sécurité ** de l’entreprise.

Perspectives de solutions : Vers une adoption maîtrisée

Pour sortir du Shadow AI, l’entreprise doit passer d’une posture de contrôle à une posture d’orchestration.

- Acculturation et formation : C’est le levier n°1. Les employés ayant reçu plus de 81 heures de formation par an économisent en moyenne 14 heures par semaine, contre seulement 3 heures pour les autres.

- Programmes “Sandbox” : Au lieu d’interdire, il faut créer des espaces sécurisés (bacs à sable) où les collaborateurs peuvent tester des outils personnels sous surveillance, permettant de transformer le Shadow AI en un pipeline d’innovation interne.

- Modèles internes et spécifiques : Proposer des outils adaptés aux rôles spécifiques permet de répondre aux besoins réels des métiers tout en maintenant la conformité.

Pour conclure, je pense que le succès de l’IA ne dépend pas de la puissance de l’outil, mais de la solidité des fondations humaines. Les entreprises qui parviennent à transformer le Shadow AI en un avantage stratégique sont celles qui investissent autant dans la culture et la formation que dans la technologie