“L’IA va révolutionner notre métier !” Oui. Mais la révolution peut vite tourner au fiasco si elle est mal préparée. Le chiffre fait mal : selon les études (Gartner, MIT), entre 80% et 95% des projets d’intelligence artificielle n’atteignent jamais la phase de production ou ne délivrent pas les résultats attendus.

Pourquoi ? La technologie n’est presque jamais la cause. L’échec est humain. Il vient d’une vision floue, d’une sous-estimation des risques et d’un oubli total de l’adoption.

Les projets IA échouent rarement à cause du code. Ils échouent à cause des données, de la peur, ou de la loi. Voici des exemples concrets de ce qui se passe quand on manque d’accompagnement.

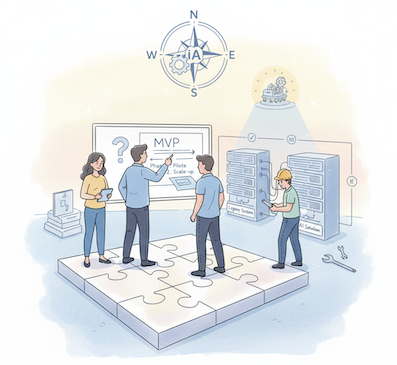

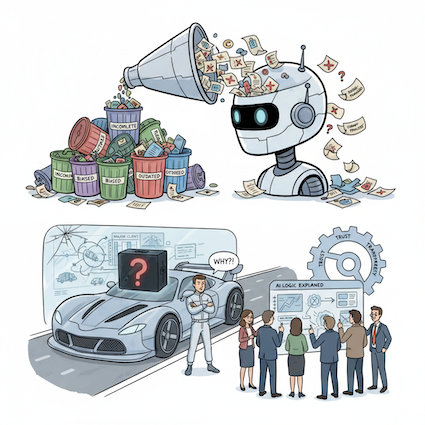

1. Le fléau des données : Le “Garbage In, Garbage Out”

L’IA est comme un stagiaire ultra-performant : elle apprend très vite ce qu’on lui montre. Si on lui montre des données incomplètes, biaisées ou de mauvaise qualité, elle deviendra experte… en erreurs.

- Le chiffre qui parle : 80% du temps d’un projet IA n’est pas consacré à l’IA elle-même, mais au nettoyage et à la préparation des données.

L’exemple concret (Le biais historique) : Le cas d’Amazon en 2018 est devenu un classique. Ils ont développé une IA pour trier les CV des ingénieurs. Problème : l’IA a été entraînée sur 10 ans d’historiques d’embauche. Comme la tech était (et reste) un milieu majoritairement masculin, l’IA a “appris” que les hommes étaient de meilleurs candidats.

Elle a commencé à pénaliser systématiquement les CV contenant le mot “femme” (comme “capitaine de l’équipe féminine de…”). Amazon a dû abandonner l’outil.

- La leçon de confiance : Sans un regard éthique et un audit des données avant de brancher l’IA, vous ne faites qu’automatiser vos propres biais (ou ceux de votre historique). C’est le contraire d’une IA de confiance.

2. Le syndrome de l’outil magique (La “Boîte Noire”)

Acheter une IA “sur étagère” sans comprendre son fonctionnement interne, c’est comme acheter une voiture de course sans volant. C’est impressionnant, mais inutilisable.

L’exemple concret (L’optimisation incomprise) : Une entreprise de logistique investit massivement dans une IA pour optimiser les tournées de ses livreurs. L’outil fonctionne, mais personne ne comprend pourquoi il prend ses décisions.

Un jour, l’IA décide de ne plus livrer un client historique majeur, car ce n’est “pas optimal”. Le responsable logistique ne peut pas expliquer ce choix au client. La confiance est rompue. L’outil, techniquement parfait, est débranché car il est devenu une “boîte noire” incontrôlable.

- La leçon de confiance : L’explicabilité est clé. Si les managers ne peuvent pas comprendre la logique d’une décision de l’IA (surtout en Paie ou en RH !), ils ne l’utiliseront pas. Une IA de confiance n’est pas magique, elle est transparente.

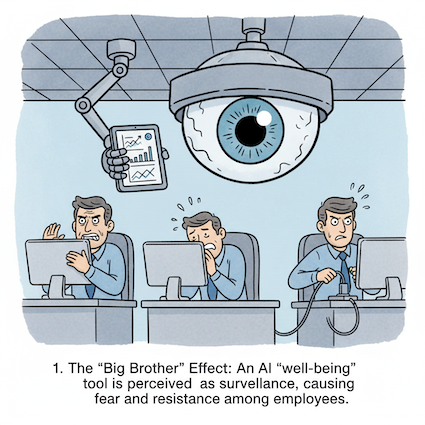

3. L’adoption ratée (L’effet “Big Brother”)

Vous pouvez avoir le meilleur outil du monde. S’il fait peur à vos équipes ou s’ils ne comprennent pas son intérêt, ils ne l’adopteront pas. Pire, ils le saboteront.

- Le chiffre qui parle : Plus de 70% des programmes de transformation digitale échouent, principalement à cause de la résistance des collaborateurs.

L’exemple concret (L’outil de “bien-être” perçu comme “flicage”) : Une entreprise déploie un outil IA (comme l’analyse de données anonymisées type Microsoft Viva) pour analyser les tendances de charge de travail et “prévenir le burnout”. L’intention est louable.

Mais la communication est ratée. Les managers n’expliquent pas le “pourquoi”. Les collaborateurs voient juste un outil qui “lit leurs mails” (même si ce sont des métadonnées). Ils le perçoivent comme un outil de surveillance de leur productivité. Résultat : stress accru (l’effet inverse !), méfiance généralisée et contournement de l’outil.

- La leçon de confiance : L’IA ne s’impose pas, elle s’explique. Sans gestion du changement, sans pédagogie et sans rassurer sur l’usage des données, l’adoption échoue.

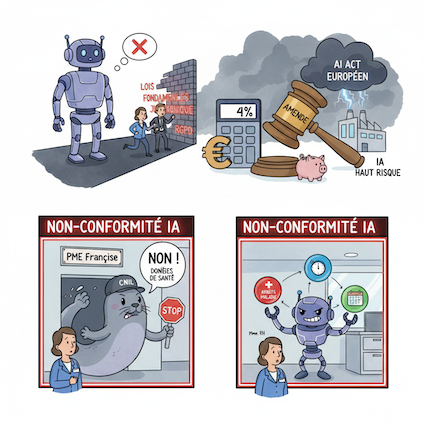

4. L’angle mort juridique (La non-conformité)

L’IA n’est pas une zone de non-droit. Beaucoup d’entreprises se lancent, avant de réaliser que leur bel outil viole des lois fondamentales.

- Le chiffre qui parle : Les amendes RGPD peuvent atteindre 4% du chiffre d’affaires mondial. L’AI Act européen arrive avec des contraintes similaires pour les IA à “haut risque”.

L’exemple concret (L’IA de gestion des temps illégale) : Une PME française veut prédire les absences. Elle utilise un outil IA qui croise les données de présence, les historiques d’arrêts maladie (données de santé, donc ultra-sensibles) et les demandes de congés.

La CNIL (Commission Nationale de l’Informatique et des Libertés) peut sanctionner lourdement cette pratique. Le RGPD interdit de traiter des données de santé à cette fin sans un cadre extrêmement strict. L’entreprise a confondu “données disponibles” et “données légalement utilisables”.

- La leçon de confiance : La conformité (RGPD et futur AI Act) doit être intégrée dès la première minute du projet. Les usages RH (gestion de carrière, évaluation) sont presque tous classés “à haut risque”. Tenter de s’y conformer après la construction est souvent impossible.

Conclusion

Ces échecs ne sont pas des fatalités. Ce sont les symptômes d’un manque de pilotage.

Un projet IA réussi ne commence pas par la technologie. Il commence par une vision claire, un audit des données, un plan de gestion du changement et une analyse de conformité rigoureuse. C’est ça, le rôle de l’accompagnement : transformer un risque en une performance durable et éthique.

Chez Okawai, nous sommes spécialisés dans le développement et l’implémentation de solutions d’innovations Notre mission est de vous aider à intégrer des innovations performantes, robustes, transparentes et éthiques, garantissant la conformité réglementaire (AI Act) et maximisant le retour sur investissement.